Apple、「ハッシュ衝突」の影響を受けるNeuralHash技術はCSAM検出に使用されるバージョンではないと発表

開発者のAsuhariet Yvgar氏は今朝、Appleが iCloud Photos 内の児童性的虐待マテリアル(CSAM)を検出するために使用しているNeuralHashアルゴリズムをリバースエンジニアリングしたと述べ、 証拠をGitHubに 、 詳細をRedditに 投稿した。

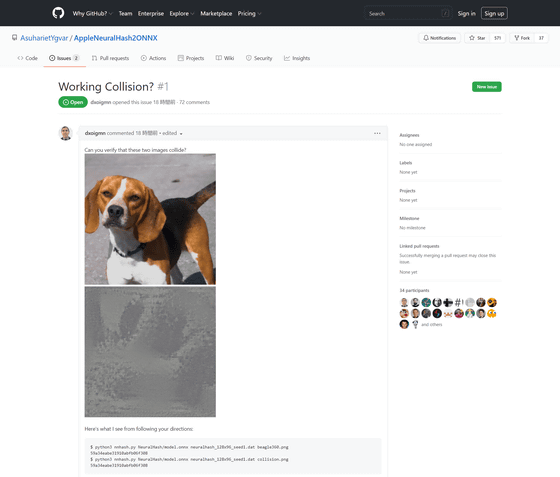

イヴガー氏は、コードが隠されていたiOS 14.3のNeuralHashアルゴリズムをリバースエンジニアリングし、Pythonで再構築したと述べた。彼が調査結果をアップロードした後、別のユーザーが

衝突、つまり 2 つの一致しない画像が同じハッシュを共有する問題を引き起こす

ことができました。セキュリティ研究者は、衝突の可能性により CSAM システムが悪用される可能性があるため、この可能性について警告しています。

Motherboard

への声明の中で、Apple は、Yvgar がリバースエンジニアリングした NeuralHash のバージョンは、CSAM システムで使用される最終実装と同じではないと述べました。 Apple はまた、アルゴリズムをセキュリティ研究者が検証できるように公開したと述べたが、人間による検証とともに、しきい値を超えた後に CSAM の一致を検証する 2 番目の非公開のサーバー側アルゴリズムが存在します。

しかしAppleはMotherboardに対し、GitHub上でユーザーが分析したバージョンは汎用バージョンであり、iCloud Photos CSAM検出に使用される最終バージョンではないと電子メールで伝えた。 Appleはアルゴリズムも公開したと述べた。

「NeuralHashアルゴリズムは[…]署名されたオペレーティングシステムのコードの一部として含まれており、[そして]セキュリティ研究者は説明どおりに動作することを検証できる」とAppleの文書の1つに書かれている。 Appleはまた、ユーザーが30件の一致のしきい値を超えた後、Appleのサーバー上で実行される2番目の非公開アルゴリズムが結果をチェックすると述べた。

ジョンズ・ホプキンス大学で暗号学を教え、Apple の CSAM システムを声高に批判してきたマシュー・グリーン氏は Motherboard に対し、衝突が「この機能のために存在する」のであれば、「Apple が最終的にアクティブ化するシステムにも衝突は存在するだろう」と予想していると語った。

「もちろん、展開する前にハッシュ関数を再スピンする可能性はあります」と彼は言う。 「しかし、概念実証としては、これは間違いなく有効です」と彼は GitHub で共有された情報について語った。

しかし、別の研究者であるニコラス・ウィーバー 氏 は、人的要素があるため、非CSAMハッシュをCSAMに操作することでできることは、誤検知を取り除くために「フィルタを実装するまで、ゴミ画像でAppleの対応チームを悩ませること」だけだとMotherboardに語った。 。実際に Apple のシステムをだますには、NCMEC が提供するハッシュへのアクセスも必要となり、30 を超える衝突画像の作成が必要になりますが、最終結果は人間の監視を欺くことはできません。

Apple は自社の NeuralHash システムを使用して、国立行方不明児童センター (NCMEC) などの機関が提供する画像ハッシュのデータベースとユーザーのデバイス上の画像を照合し、CSAM を検索しています。このシステムは完全一致を生成するように設計されており、Apple によれば、 iCloud アカウントに誤ってフラグが立てられる可能性は 1 兆分の 1 であるとのことです。

Apple は、一連の児童安全機能の一部として、iOS および iPadOS 15 に NeuralHash CSAM システムを実装することを計画しています。これは、Apple が顧客やプライバシー擁護派から批判を受け、非常に物議を醸す決定となっています。 Apple は 、追加の文書 や 幹部へのインタビュー を通じて、システムの実装について顧客やセキュリティ研究者を安心させようと努めてきました。

![Apple、iOS 18 および iPadOS 18 の 6 回目のベータ版を開発者に提供 [アップデート: パブリックベータ版が利用可能]](https://i1.wp.com/cdn-ak.f.st-hatena.com/images/fotolife/h/haosan/20230801/20230801080225.png?resize=768,372&ssl=1)