Apple、WWDCに先立ってiOS 17のアクセシビリティ機能をプレビュー

Apple は本日、今年後半に登場予定の iPhone 、 iPad 、Mac 向けの幅広い新しいアクセシビリティ機能 をプレビューしました 。

Apple は、「認知、音声、視覚のアクセシビリティのための新しいソフトウェア機能が今年後半に登場する」と述べており、これらが

iOS 17

、

iPadOS 17

、および macOS 14 の一部となることを強く示唆しています。新しいオペレーティング システムは、 6月初旬のWWDCでプレビューされ、秋に発売される。

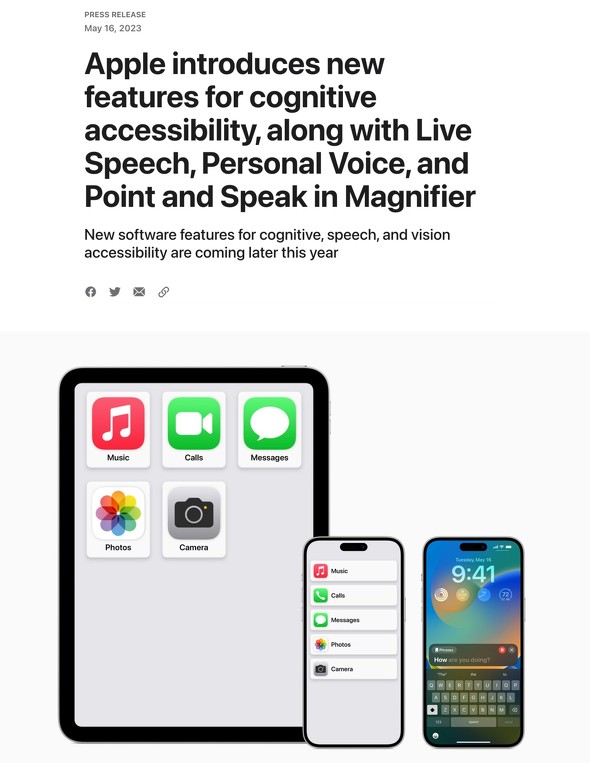

補助アクセス

Assistive Access は、iPhone および iPad のアプリとエクスペリエンスを核となる機能に絞り込みます。このモードには、メッセージ、カメラ、 写真 、音楽に加えて、電話と FaceTime のカスタマイズされたエクスペリエンスが含まれており、これらは 1 つの通話アプリに統合されています。この機能は、ハイ コントラストのボタンと大きなテキスト ラベルを備えた簡素化されたインターフェイスと、エクスペリエンスの調整に役立つツールを提供します。たとえば、ユーザーは ホーム画面 とアプリに対してより視覚的なグリッドベースのレイアウトを選択するか、テキストを好むユーザーには行ベースのレイアウトを選択できます。

ライブスピーチとパーソナルボイスによる高度なスピーチアクセシビリティ

iPhone、iPad、Mac の Live Speech を使用すると、ユーザーは言いたいことを入力し、電話や FaceTime 通話、さらには対面での会話中にそれを読み上げることができます。ユーザーは、よく使用されるフレーズを保存して、会話にすぐに取り入れることもできます。

筋萎縮性側索硬化症 (ALS) と最近診断されたユーザーなど、話す能力を失うリスクのあるユーザーは、パーソナル ボイスを使用して自分に似たデジタル音声を作成できます。ユーザーは、ランダム化された一連のテキスト プロンプトを読みながら、「iPhone」または「iPad」で 15 分間の音声を録音するだけです。この機能は、オンデバイスの機械学習を使用してユーザーの情報を安全かつプライベートに保ち、Live Speech と統合しているため、ユーザーは個人の音声で話すことができます。

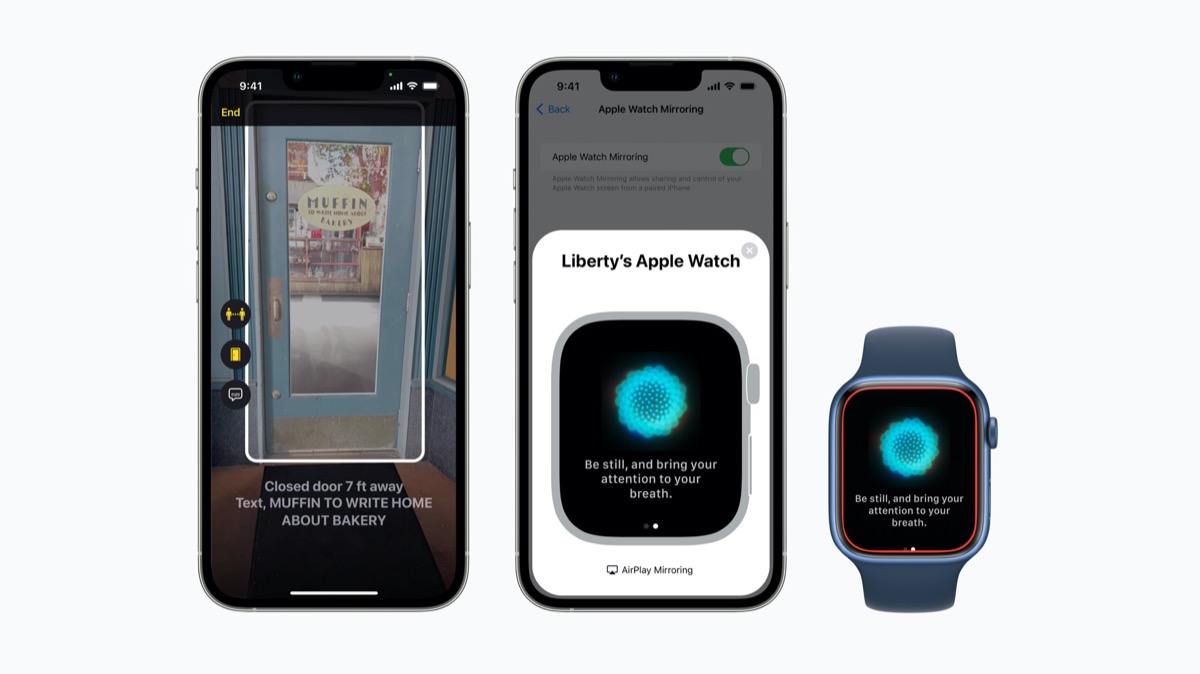

拡大鏡とポイントアンドスピーキングの検出モード

拡大鏡アプリでは、ポイント アンド スピークにより、ユーザーが複数のテキスト ラベルを持つ物理オブジェクトを操作するのに役立ちます。たとえば、家電製品の使用中に、Point and Speak はカメラ アプリ、LiDAR スキャナー、およびデバイス上の機械学習からの入力を組み合わせて、ユーザーがキーパッド上で指を動かすとボタン上のテキストをアナウンスします。

Point and Speak は、iPhone および iPad の拡大鏡アプリに組み込まれており、VoiceOver と連携して動作し、人物検出、ドア検出、画像説明などの他の拡大鏡機能と併用して、ユーザーが物理環境をより効果的にナビゲートできるようにします。

その他の機能

- 聴覚障害者または難聴ユーザーは、特定のカスタマイズ オプションを使用して Made for iPhone 聴覚デバイスを Mac に直接ペアリングできます。

- 音声コントロールはテキスト編集のための発音の提案を取得するため、音声で入力するユーザーは、「do」、「due」、「dew」など、似たように聞こえるいくつかの単語の中から適切な単語を選択できます。

- 音声コントロール ガイドは、ユーザーがタッチや入力の代わりに音声コマンドを使用するためのヒントやコツを学ぶのに役立ちます。

- Switch Control を有効にして、任意のスイッチを仮想ビデオ ゲーム コントローラーに変えることができるようになりました。

- Finder、メッセージ、メール、カレンダー、メモなどの Mac アプリ全体でテキスト サイズを簡単に調整できるようになりました。

- 速いアニメーションに敏感なユーザーは、メッセージや Safari で GIF などの動く要素を含む画像を自動的に一時停止できます。

- ユーザーは、 Siri が話す速度を 0.8 倍から 2 倍の範囲でカスタマイズできます。

- ショートカットには、新しい「これを覚えておく」アクションが追加され、認知障害のあるユーザーがメモ アプリで視覚的な日記を作成できるようになります。