Apple、CSAM検出の懸念に対処、国ごとにシステムの拡張を検討

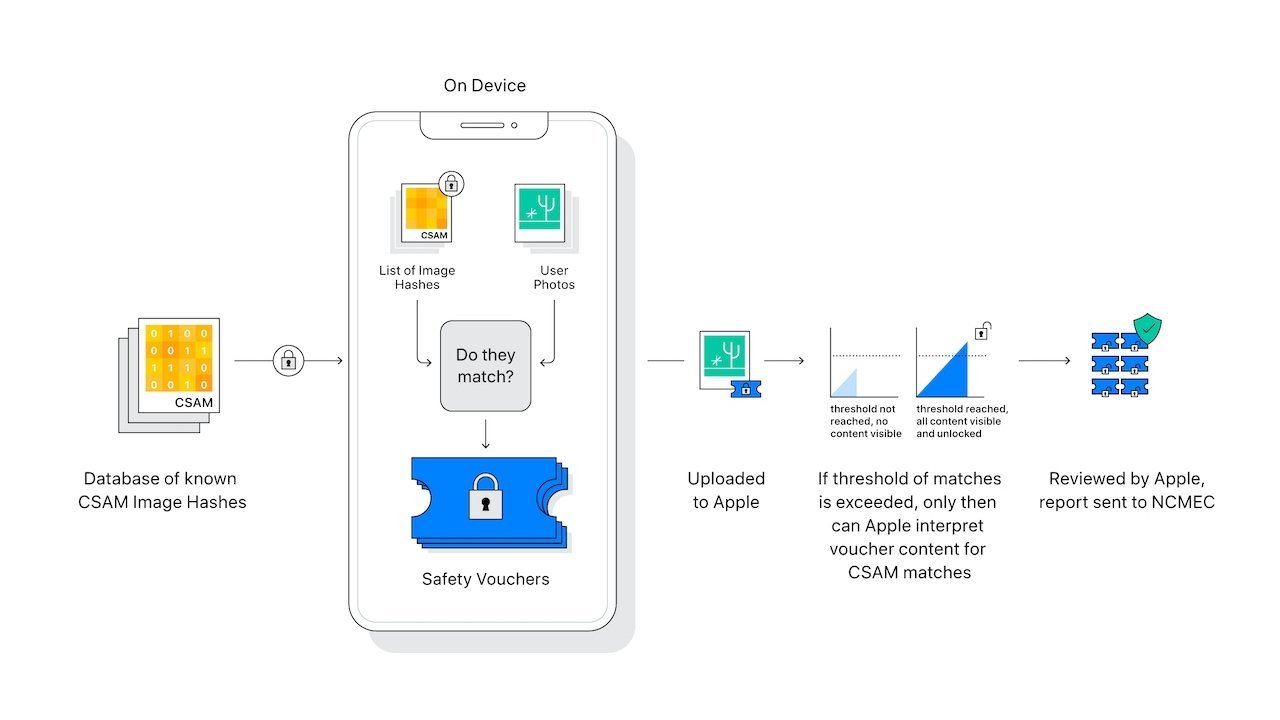

Apple は今週、今年後半の iOS 15 および iPadOS 15 から、 iCloud 写真に保存されている既知の児童性的虐待資料 (CSAM) 画像を検出できるようになり 、Apple がこれらの事例を国立行方不明センターに報告できるようになると発表しました。 Exploited Children は、全米の法執行機関と協力して活動する非営利団体です。

この計画

により、一部のセキュリティ研究者やその他の関係者の間では

、政治活動の抑圧などの不正な目的で、Apple が最終的に政府によって非 CSAM 画像をハッシュ リストに追加するよう強制される可能性があるとの懸念が生じている。

著名な内部告発者エドワード・スノーデン 氏は、「どれほど善意があったとしても、アップルはこれによって全世界に大規模な監視を展開している」と述べ 、「今日児童ポルノをスキャンできれば、明日は何でもスキャンできるだろう」と付け加えた。非営利電子フロンティア財団 もアップルの計画を批判し 、「徹底的に文書化され、慎重に検討され、範囲が狭いバックドアであっても、依然としてバックドアである」と述べた。

これらの懸念に対処するために、Apple は本日、自社の計画について追加のコメントを提供しました。

Apple の既知の CSAM 検出システムは、発売時点では米国に限定されており、一部の政府がシステムを悪用しようとする可能性に対処するため、Apple は に対し、システムを特定の国で世界的に拡大する可能性を検討することを認めました。法的評価を実施した後、国ごとに評価されます。 Apple は、システムを世界的に拡大する場合の時期については明らかにしなかった。

Appleはまた、世界の特定の地域がシステムを悪用しようとして安全組織を汚職することを決定したという仮説の可能性についても言及し、システムの保護の最初の層は、ユーザーが不適切な画像を使用していると警告される前の未公開のしきい値であると指摘した。 Appleは、たとえしきい値を超えたとしても、手作業による審査プロセスがさらなる障壁となり、既知のCSAM画像が存在しないことを確認すると述べた。 Appleは、最終的に報告されたユーザーをNCMECや法執行機関に報告することはなく、システムは引き続き設計どおりに機能すると述べた。

Appleはまた、このシステムの支持者の一部を強調し、一部の関係者は児童虐待と戦うための同社の取り組みを賞賛した。

Family Online Safety Institute の CEO である Stephen Balkam 氏は次のように述べています。 「子供たちをオンラインで保護する際に親が直面する課題を考慮すると、テクノロジー企業は新たなリスクや実際の被害に対応するために安全ツールを継続的に反復し、改善することが不可欠です。」

Appleは、システムが悪用される可能性に関して特効薬はないことを認めたが、既知のCSAM画像検出のみにシステムを使用することにコミットしていると述べた。

注: このトピックに関する議論の政治的または社会的性質のため、議論スレッドは 政治ニュース フォーラムにあります。すべてのフォーラム メンバーとサイト訪問者はスレッドを読んでフォローすることができますが、投稿できるのは少なくとも 100 件の投稿があるフォーラム メンバーに限られています。