Apple、iCloud 写真がオフになっている場合、児童性的虐待素材の検出が無効になることを確認

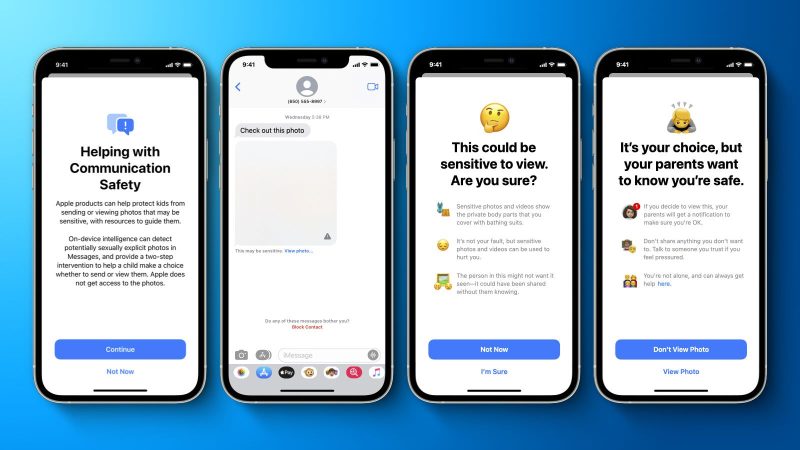

Apple は 本日、米国の iPhone および iPad で児童性的虐待マテリアル (CSAM) を検出するための新しい方法が iOS 15 および iPadOS 15 に導入されることを発表しました 。

ユーザーのデバイスは、既知の CSAM 画像ハッシュの読み取り不能なデータベースをダウンロードし、デバイス上でユーザー自身の写真と比較し、

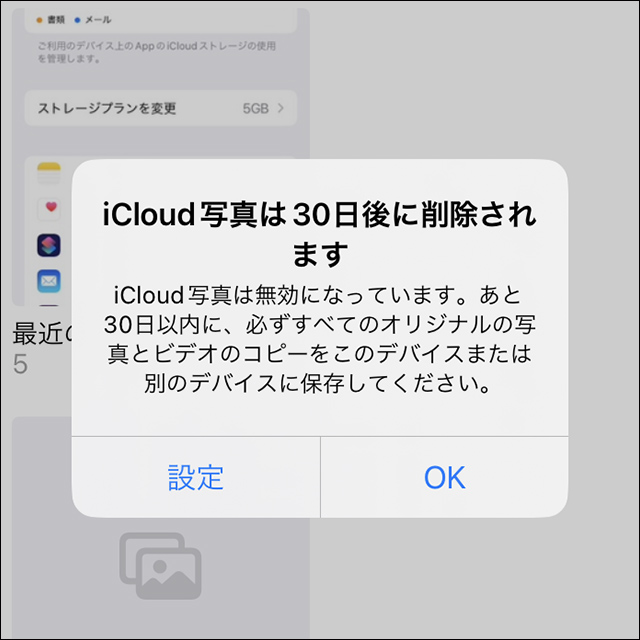

iCloud 写真

にアップロードされる前に既知の CSAM 素材であるかどうかフラグを立てます。 Apple は、これは CSAM を検出し子供を保護するための非常に正確な方法であると述べています。

CSAM 画像スキャンはオプション機能ではなく、自動的に行われますが、Apple は に対し、「iCloud 写真」機能がオフになっている場合には既知の CSAM 画像を検出できないことを確認しました。

Apple の方法は、デバイス上の既知の CSAM 写真を識別し、バウチャーが添付された「iCloud 写真」にアップロードされるときにフラグを立てることで機能します。一定数のバウチャー (別名フラグ付き写真) が「iCloud 写真」にアップロードされると、Apple はバウチャーを解釈し、手動でレビューを行うことができます。 CSAM コンテンツが見つかった場合、ユーザー アカウントは無効になり、国立行方不明児童搾取センターに通知されます。

Apple は「iCloud 写真」をスキャンして CSAM フラグを探しているため、「iCloud 写真」が無効になっているとこの機能が機能しないのは当然です。 Apple はまた、ユーザーのデバイスで「iCloud 写真」が無効になっている場合、 iCloud バックアップ内の既知の CSAM 画像を検出できないことを確認しました。

Appleが特に既知の児童性的虐待資料のハッシュをスキャンしていることは注目に値するが、ユーザーの写真ライブラリを広範囲に検査したり、児童虐待者の間でまだ流通していない個人画像をスキャンしたりしているわけではない。それでも、ユーザーの写真ライブラリをスキャンする Apple の取り組みについてプライバシー上の懸念があるユーザーは、「iCloud 写真」を無効にすることができます。

セキュリティ研究者らはAppleのCSAMイニシアチブに 懸念を表明し 、将来的には政治や安全に影響を及ぼす可能性のある他の種類のコンテンツも検出できるようになる可能性があると懸念しているが、現時点では児童虐待者を捜索するAppleの取り組みは限られている。

注: このトピックに関する議論の政治的または社会的性質のため、議論スレッドは 政治ニュース フォーラムにあります。すべてのフォーラム メンバーとサイト訪問者はスレッドを読んだりフォローしたりできますが、投稿できるのは少なくとも 100 件の投稿があるフォーラム メンバーに限られています。

/cdn.vox-cdn.com/uploads/chorus_asset/file/23951391/STK088_VRG_Illo_N_Barclay_4_spotify.jpg?resize=1200,628&ssl=1)