Apple、iCloud写真から既知のCSAMを検出するという物議を醸す計画を放棄

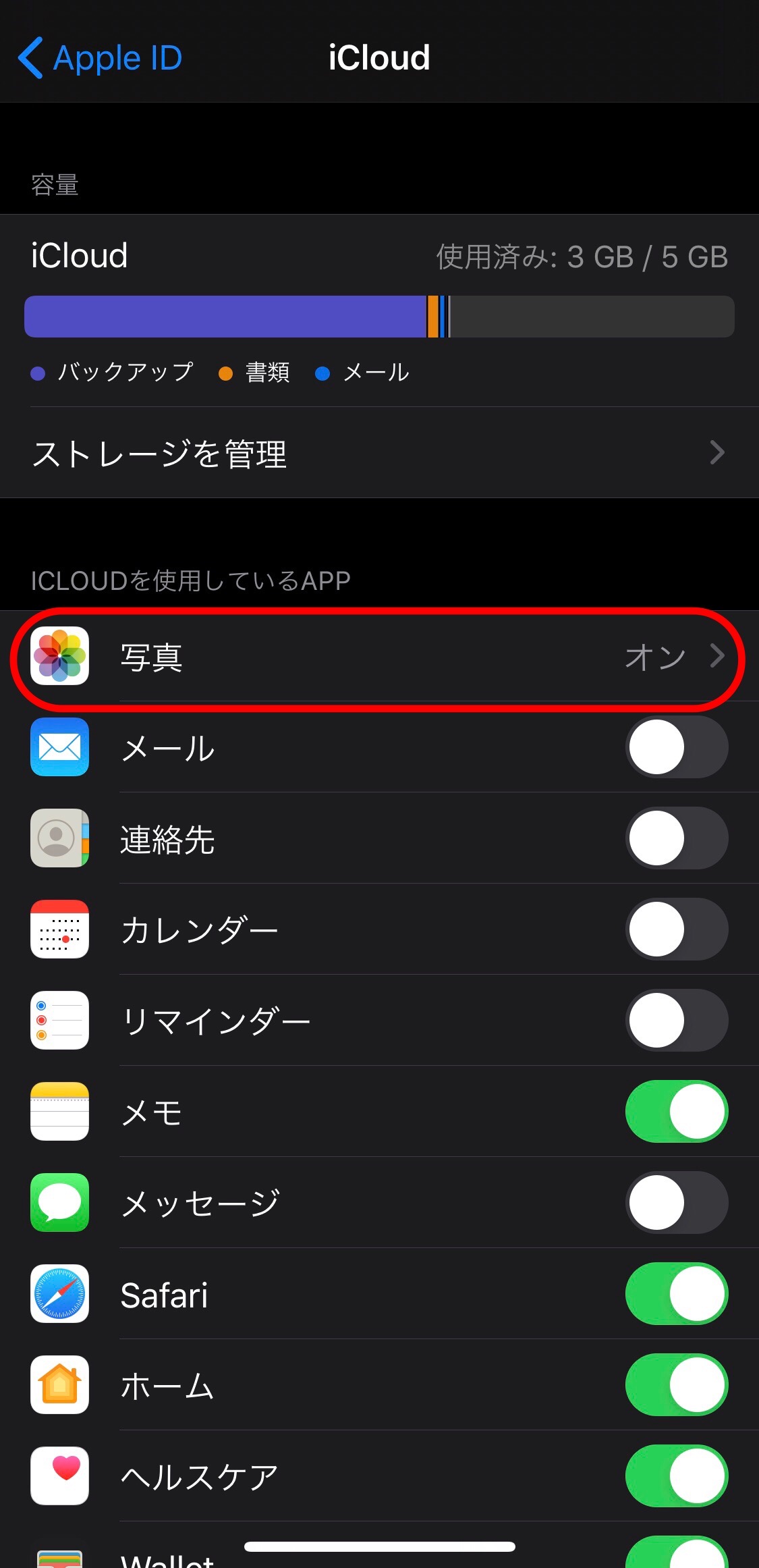

WIRED と共有された 声明によると、Appleは本日、 iCloud写真でエンドツーエンドの暗号化を利用できる ようにすることに加えて、iCloud写真に保存されている既知の児童性的虐待マテリアル(CSAM)を検出するという物議を醸した計画を放棄したと発表した。

Apple の声明全文:

昨年提案した児童保護の取り組みに関するフィードバックを収集するために専門家と広範な協議を行った後、2021 年 12 月に初めて利用可能になった通信安全機能への投資をさらに深めています。さらに、以前に提案した CSAM 検出を進めないことを決定しました。 iCloud写真用のツール。企業が個人データを精査しなくても子どもたちは保護できます。当社は今後も政府、児童擁護団体、その他の企業と協力して、若者を保護し、プライバシーの権利を守り、子どもたちと私たち全員にとってインターネットをより安全な場所にしていきます。 。

2021年8月、Appleは 3つの新しい児童安全機能の計画を発表した 。これには、iCloud写真に保存されている既知のCSAM画像を検出するシステム、メッセージアプリ内の露骨な性的写真をぼかす 通信安全オプション 、Siriの児童搾取リソースが含まれる。 Communication Safety は、2021 年 12 月に iOS 15.2 で米国で開始され、その後英国、カナダ、オーストラリア、ニュージーランドに拡大され、Siri リソースも利用可能になりましたが、CSAM 検出は最終的に開始されることはありませんでした。

Appleは当初、CSAM検出が2021年末までにiOS 15およびiPadOS 15のアップデートに実装されると述べていたが、同社は最終的に「顧客、擁護団体、研究者などからのフィードバック」に基づいてこの機能を延期した。 1 年間の沈黙を経て、Apple は CSAM 検出計画を完全に放棄しました。

Appleは、CSAM検出システムが「ユーザーのプライバシーを念頭に置いて設計されている」と約束した。このシステムは、児童安全保護団体からの「既知の CSAM 画像ハッシュのデータベースを使用したデバイス上での照合」を実行し、Apple がそれを「ユーザーのデバイスに安全に保存される読み取り不可能なハッシュのセット」に変換する予定でした。

Apple は、既知の CSAM 画像ハッシュを持つ iCloud アカウントを、米国の法執行機関と協力して活動する非営利団体である国立行方不明児童搾取センター (NCMEC) に報告する予定でした。 Appleは、システムによってアカウントに誤ってフラグが付けられる確率が「年間1兆分の1未満」であることを保証する「しきい値」を設け、さらに、フラグが付けられたアカウントを人間が手動で確認する予定だと述べた。

Apple の計画は、 セキュリティ研究者 、 電子フロンティア財団 (EFF) 、 政治家 、 政策団体 、 大学研究者 、さらには一部の Apple 従業員 を含む幅広い個人や組織によって批判されました。

一部の批評家は、この機能によりデバイスに「バックドア」が作成され、政府や法執行機関がユーザーを監視するために使用できると主張した。もう 1 つの懸念は、誰かが意図的に CSAM 画像を他人の iCloud アカウントに追加して、そのアカウントにフラグを立てる可能性を含む誤検知でした。

注: このトピックに関する議論の政治的または社会的性質のため、議論スレッドは 政治ニュース フォーラムにあります。すべてのフォーラム メンバーとサイト訪問者はスレッドを読んだりフォローしたりできますが、投稿できるのは少なくとも 100 件の投稿があるフォーラム メンバーに限られています。