iOS 15 のライブ テキスト機能を使用すると、書いたメモをデジタル化したり、標識にある番号に電話したり、メニューを翻訳したりできるようになります

iOS 15 では、Apple は Live Text と呼ばれる新機能を導入します。この機能は、カメラのビューファインダーまたは撮影した写真に表示されたテキストを認識し、それを使用していくつかのアクションを実行できるようにします。

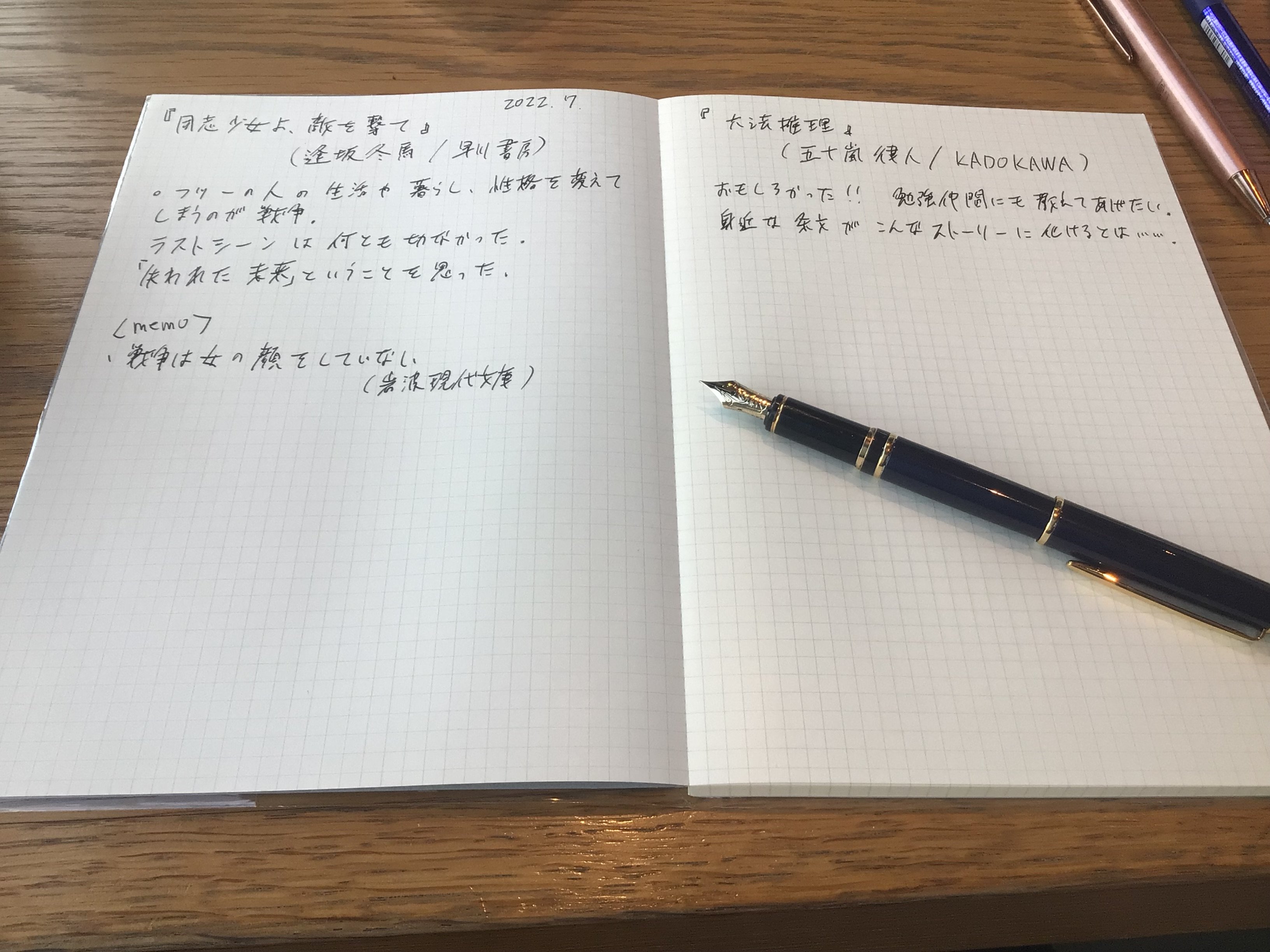

たとえば、Live Text を使用すると、電話をかけるオプションを使用して店頭から電話番号を取得したり、マップで場所の名前を検索して道順を取得したりできます。光学式文字認識も組み込まれているため、写真の中から手書きのメモの画像を検索し、テキストとして保存することもできます。

Live Text のコンテンツ認識は、QR コードから写真に表示される電子メールに至るまであらゆるものに拡張されており、このデバイス上のインテリジェンスは Siri の 提案にも反映されます。

たとえば、電子メール アドレスが写っている写真を撮り、メール アプリを開いてメッセージの作成を開始すると、Siri のキーボード提案により、メッセージの宛先フィールドに「カメラからの電子メール」を追加するオプションが表示されます。

その他の Live Text オプションには、カメラのビューファインダーからテキストや写真をコピーして他の場所に貼り付ける機能、共有、辞書で検索、英語、中国語 (簡体字と繁体字の両方)、フランス語、イタリア語、ドイツ語、スペイン語、またはポルトガル語。

写真内のテキストを認識することで、写真を場所、人物、シーン、オブジェクトなどごとに分類することもできます。たとえば、Spotlight 検索で単語や語句を検索すると、そのテキストが含まれる写真がカメラ ロールから表示されます。

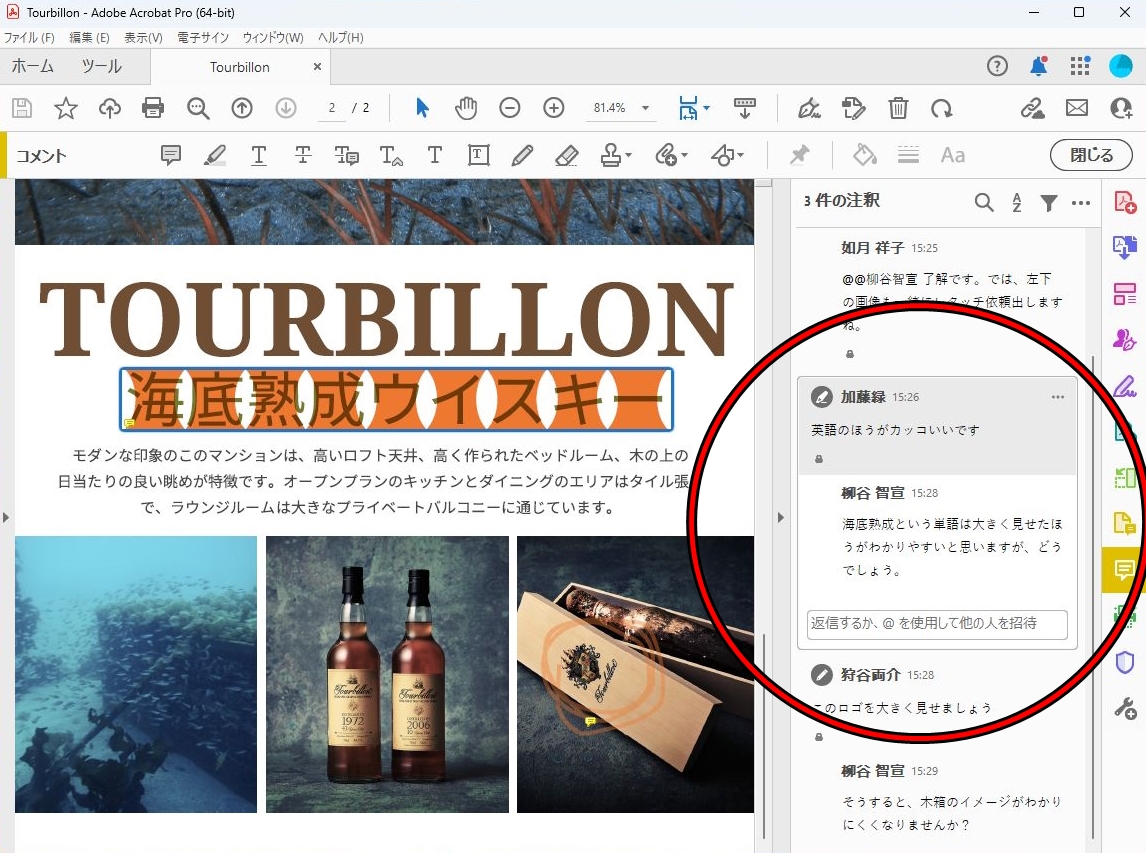

Live Text は、 写真 、スクリーンショット、クイック ルック、Safari で機能し、カメラを使用したライブ プレビューでも機能します。カメラ アプリでは、テキストが表示されるものに iPhone のカメラを向けるといつでも利用でき、テキスト コンテンツがビューファインダーで認識されると右下隅に小さなアイコンが表示されます。アイコンをタップすると、認識されたテキストをタップして、それを使用してアクションを実行できます。撮影した画像を表示しているときに、「写真」アプリに同様のアイコンが表示されます。

別のニューラル エンジン機能として、Apple は Visual Look Up と呼ばれるものを導入しています。これにより、物体やシーンの写真を撮って、そこからより多くの情報を得ることができます。 iPhone のカメラを芸術作品、動植物、ランドマーク、本などに向けると、カメラがコンテンツを認識し、コンテキストを追加できる関連する「Siri」知識があることをアイコンで示します。

Live Text は Apple のニューラル エンジンに大きく依存しているため、この機能は、少なくとも A12 Bionic 以上のチップを搭載した iPhone および iPad でのみ利用できます。つまり、iPhone X 以前のモデル、または iPad mini (第 5 世代) より前のモデルを使用している場合にのみ利用できます。 )、 iPad Air (2019、第 3 世代)、または iPad (2020、第 8 世代) の場合は、残念ながらアクセスできません。

iOS 15のベータ版は現在開発者の手に渡っており、パブリックベータ版は来月リリースされる予定だ。 iOS 15の正式リリースは秋の予定です。